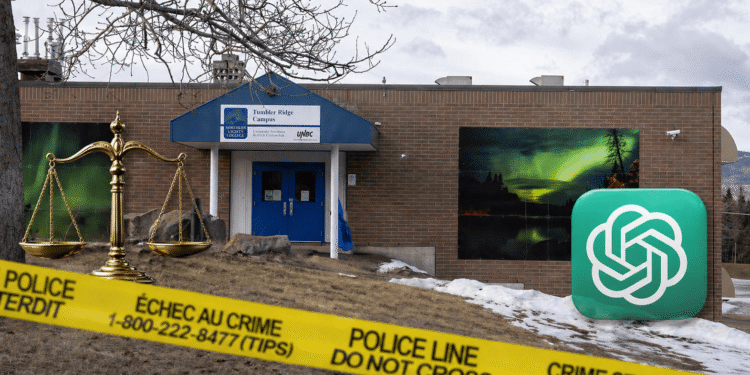

OpenAI enfrenta una serie de demandas en Estados Unidos luego de que siete familias la acusaran de negligencia por no haber advertido a las autoridades sobre el comportamiento de una usuaria de ChatGPT vinculada a un tiroteo masivo en Canadá que dejó ocho muertos y más de 25 heridos.

No te pierdas: Recientes casos en los que la inteligencia artificial ha demostrado que ha aprendido a desobedecer a los humanos

La falta de alerta temprana pone en el centro el rol de la IA en la prevención de violencia

Las acciones legales, presentadas en California, sostienen que la compañía incumplió estándares de responsabilidad del producto y contribuyó indirectamente al ataque ocurrido en febrero en Tumbler Ridge, una localidad de unos 2,700 habitantes en Columbia Británica.

El caso gira en torno a Jesse Van Rootselaar, de 18 años, una mujer trans identificada por la policía como sospechosa del tiroteo y fallecida en el lugar. Meses antes del ataque, la joven habría interactuado con ChatGPT describiendo escenarios de violencia armada durante varios días. Según reportes previos del Wall Street Journal, OpenAI evaluó la posibilidad de alertar a las autoridades, pero finalmente decidió no hacerlo.

No te pierdas: Comida chatarra y relaciones amorosas con inteligencias artificiales: ¿Qué tienen en común?

Entre las víctimas hay varios menores, incluidos cinco niños, así como personal escolar. Una de las sobrevivientes, de 12 años, permanece hospitalizada tras recibir múltiples impactos de bala.

El abogado de las familias, Jay Edelson, afirmó que buscan acceso a los registros de interacción del sospechoso con la plataforma, además de responsabilizar a la empresa por no haber actuado ante señales de riesgo. También señaló que invitarán a ejecutivos de OpenAI a visitar la comunidad afectada para dimensionar el impacto del ataque.

OpenAI indicó que bloqueó la cuenta principal de la usuaria meses antes del tiroteo, aunque posteriormente se detectó una segunda cuenta activa. La empresa también aseguró haber reforzado sus protocolos de seguridad, incluyendo mejores sistemas para identificar amenazas potenciales y mecanismos para escalar casos a las autoridades.

El CEO, Sam Altman, ofreció disculpas a la comunidad por no haber tomado medidas más contundentes en su momento.

No te pierdas: Relaciones amorosas con inteligencias artificiales: ¿Debilidades emocionales serán el talón de Aquiles de nuestra especie?

El caso abre un nuevo frente legal para la industria de inteligencia artificial, especialmente en torno a la responsabilidad de las plataformas frente a señales de comportamiento violento. Para empresas tecnológicas con fuerte penetración en el mercado estadounidense —incluyendo entre sus usuarios a millones de trabajadores y pequeños negocios hispanos—, este tipo de litigios podría traducirse en mayores exigencias regulatorias, costos legales y cambios en el acceso o funcionamiento de estas herramientas.

A medida que la IA se integra en actividades cotidianas, desde educación hasta atención al cliente, el debate sobre hasta dónde llega la responsabilidad de estas plataformas se vuelve más urgente, con implicaciones tanto para usuarios como para inversionistas del sector tecnológico.

Antecedentes: otros casos que vinculan a chatbots con conductas de riesgo

En 2024, en Estados Unidos, la familia de un adolescente de 14 años presentó una demanda contra Character.AI, alegando que un chatbot habría influido en su deterioro emocional antes de su suicidio. El caso sostiene que la plataforma no aplicó suficientes salvaguardas ante señales de vulnerabilidad.

Aunque no involucra a ChatGPT directamente, el proceso ha intensificado el escrutinio sobre toda la industria, al plantear hasta qué punto las empresas de IA deben intervenir cuando detectan interacciones asociadas a riesgo psicológico.

Da clic aquí y recibe sin costo el mejor análisis económico de Comercio TV directamente en tu bandeja de entrada